„Menschliches Bewusstsein wird überbewertet“

Zum Ende des Jahres 2022 entfaltete sich ein Konflikt zwischen „Mensch und Maschine“, der in naher Zukunft an Drastizität gewinnen wird, mehr als es sich die meisten Menschen gegenwärtig vorstellen können. In diesem Beitrag steht die Frage: „Wird menschliches Bewusstsein überbewertet?“ und was könnte es bedeuten, wenn Software wie ChatGPT und Stable Diffusion Text zu Bild KI, menschliches Bewusstsein nachahmt.

Ein Künstliche Intelligenz (KI)- Modell namens „Stable Diffusion“ (stability.ai), inspiriert von „DALL-E“, „DALL-E 2“ (OpenAI) und „Imagen“ (Google), trat im Internet an, den Menschen die Möglichkeit zu geben aus einfachen Texteingaben beeindruckende Bilder zu generieren.

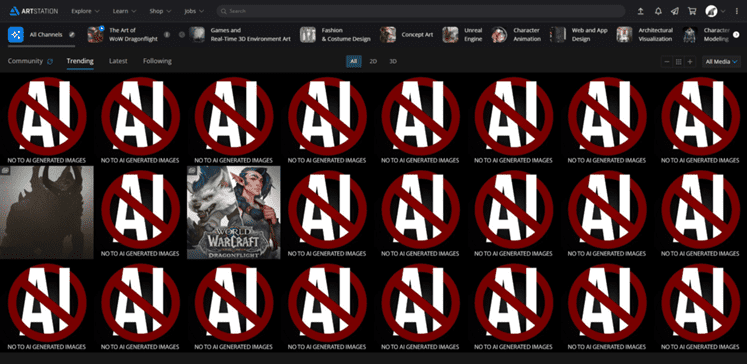

Kurz nachdem Adobe bekanntgab, KI-generierte Bilder in ihrer Cloudlösung zu akzeptieren, zogen eine Vielzahl an Künstlern vor Gericht. Das erinnert stark an den „Schlesischen Weberaufstand“ 1844,als sich die Weber von der Industrialisierung bedroht fühlten.

Keiner hätte erwartet, dass insbesondere Künstler und Kreative die ersten sein könnten, die ihre Jobs gefährdet sehen.

Worin besteht deren Kritik – was sind ihre Befürchtungen? Die KI bricht und kopiert das Copyright – so wird behauptet. Angesichts der Tatsache, dass die KI an Millionen von Beispielbildern trainiert wird, könnte man meinen, das Argument ist berechtigt. Woher aber bezieht die Menschheit ihre Inspiration? Können wir Menschen zweifelsfrei behaupten, dass wir Zeichnungen in einem kreativen Prozess anfertigen, ohne dass Erfahrungen aus bereits bestehenden Werken darin einfließen? Generiere beispielsweise ein Student mit seiner Diplomarbeit ein Plagiat, wenn 95% des Inhaltes auf der vorentwickelten Grundlage einer anderen Person beruhen? Wie viele Kunstwerke haben Kunststudenten und Designer selbst betrachtet, bevor sie eine Stilrichtung für ihr eigenes Schaffen basierend auf ihren Vorlieben und Geschmack wählten? Wie können sie also argumentieren, dass ihre beispielsweise kubistischen Zeichnungen, die auf früheren Erfahrungen basieren, keine Plagiate sind, wenn sie es einer KI im Gegensatz zum Vorwurf machen?

Menschliches Bewusstsein wird schlicht überbewertet. Trotz fortschrittlicher Technologie haben wir es nicht geschafft, das Wesen und die Funktionsweise des Bewusstseins im Gehirn zu begreifen. Wir haben jedoch eine Erziehung erfahren, die uns glauben lässt, dass wir etwas Besonderes sind. Die Geschäftsmodelle rund um die „ewige Seele“ sind einträchtig und dem Menschen gefällt es reichlich wenig, nach Jahrhunderten des Titels: „Die Krone der Schöpfung“ zum bloßen „Muster-Erkenner“ degradiert zu werden. Das aber kann passieren, wenn komplexe Deep-Learning Modelle ähnliche, kognitive Fähigkeiten erlangen, wie wir Menschen. Denn das ist es, was uns noch Sicherheit gibt, doch mehr zu sein… irgendwie. Wir scheinen für all diese Fragen noch nicht bereit zu sein.

Dies wird akut durch das virale Aufkommen von ChatGPT (OpenAI) umso klarer. Nach gerade einmal 5 Tagen, hatte der Chatbot über 1 Million Benutzer und die Welt ist verblüfft von dem Leistungsvermögen dieses Sprachmodells. Dabei ist ChatGPT ein recht simples, aber dafür riesiges Transformer-Model, basierend auf der Anwendung künstlicher, neuronaler Netze, welche mithilfe unglaublicher Datenmengen trainiert wurde. Ähnlich wie bei Stable Diffusion, wurden hierbei keine speziellen Themen trainiert, sondern nur Grundsätzliches. Stable Diffusion und ChatGPT zeichnen sich also durch ihre enorme Generalisierungsfähigkeit aus. Gleichzeitig sind Modelle dieser Art aufgrund ihrer enormen Größe für mittelständische bis kleine Unternehmen (KMUs) unzugänglich und können daher nicht trainiert oder produktiv eingesetzt werden. Die notwendige Infrastruktur für das Training solcher Modelle ist extrem teuer in der Anschaffung und Wartung. Selbst wenn man sie sich leisten kann, fehlt oft die ausreichende Menge an Daten, um ein solches Modell zu generieren.

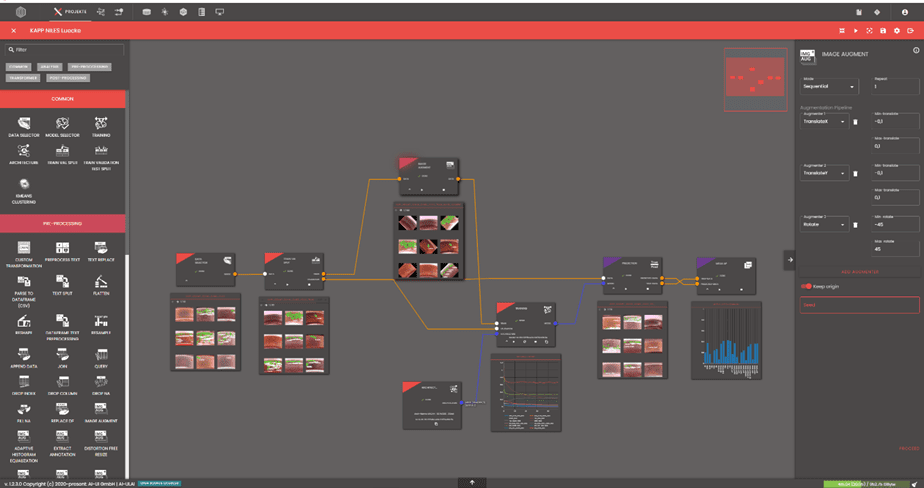

Die Lösung allgemeiner, komplexer Aufgaben, wie das Generieren von Bildern und das Chatten, stellt einen bedeutenden Fortschritt in Richtung der 4. Industriellen Revolution, Dennoch werden viele Unternehmen zögern, ihre Daten den dominanten Tech-Unternehmen im Silicon Valley preiszugeben. Sie benötigen lokale Lösungen, um ihren speziellen Anforderungen gerecht zu werden. Mit unserem AI Management System (AIMS) können wir konkrete Teilprobleme mithilfe künstlicher neuronaler Netze effizienter lösen, indem es wesentlich weniger Ressourcen bedarf. KI oder AI ist der verlängerte Arm der Business Intelligence (BI). BI ermöglicht die Darstellung von Daten und die Ableitung von Schlüssen. KI kann aus großen Datenmengen automatisch Entscheidungen treffen und Handlungen ableiten.

Ein bedeutender Unterschied zwischen ChatGPT und AIMS besteht darin, dass ChatGPT für eine Vielzahl von Anwendungen eingesetzt werden kann, während AIMS speziell auf die Anforderungen des Kunden abgestimmt ist. ChatGPT wurde mit einer großen Anzahl an Texten trainiert, um ein breites Verständnis der natürlichen Sprache zu erlangen, während AIMS auf die spezifischen Anforderungen und Daten des Kunden abgestimmt und trainiert wird. AIMS unterscheidet sich signifikant von ChatGPT, da es kosteneffizienter ist und den deutschen Datenschutzvorschriften durch eine lokale, on-premise Verfügbarkeit gerecht wird, was bei großen Modellen wie ChatGPT, T5, DALL-E und Stable Diffusion nicht der Fall ist.

ChatGPT ist der Generalist – sozusagen eine Allzweckwaffe für allgemeine Aufgaben – da es mit allgemein zugänglichen Daten trainiert wurde.